Réponse Rapide : Votre avatar numérique – l'empreinte comportementale construite à partir de vos clics, pauses, achats et schémas – prédit souvent vos décisions avant même que vous ne les preniez consciemment. Les systèmes d'identité synthétique agrègent ces données en un modèle qui peut être plus cohérent, moins biaisé, et étrangement plus "vous" que votre propre perception de vous-même. Les implications pour la confiance, la vie privée et l'autonomie sont profondes.

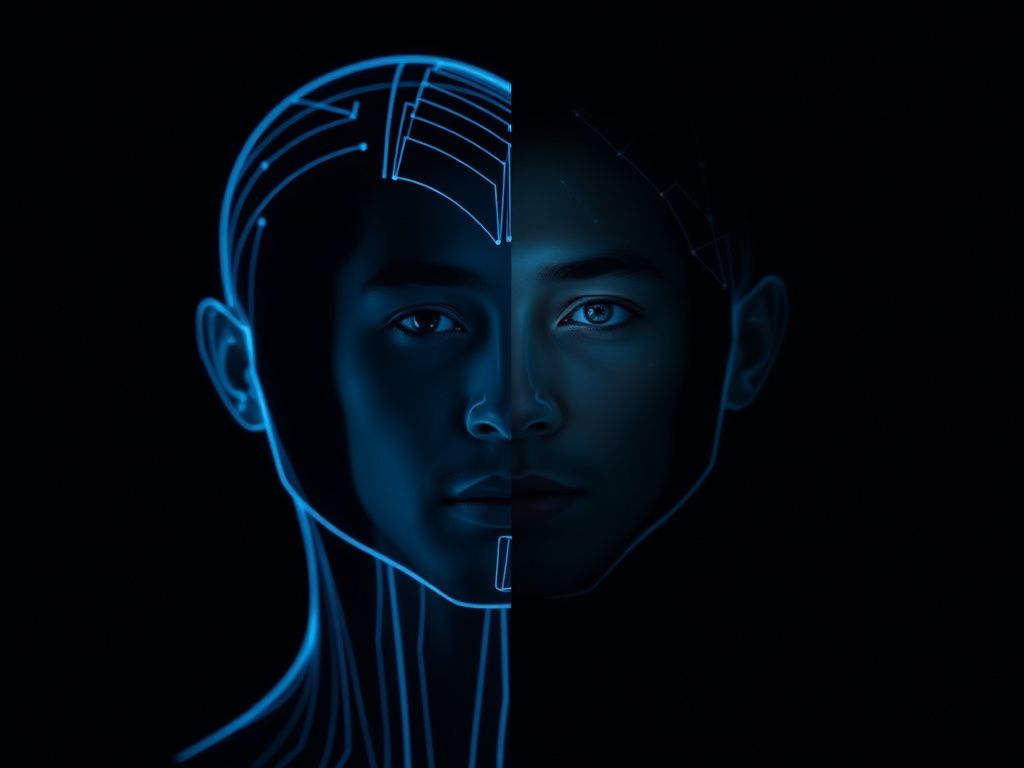

Une expérience silencieuse se déroule actuellement sur vous. Chaque application que vous ouvrez, chaque requête de recherche que vous abandonnez à mi-chemin, chaque produit sur lequel vous passez trois secondes avant de fermer l'onglet – tout cela alimente une machine qui assemble une version de vous. Pas une caricature. Un modèle comportemental de haute fidélité. Une identité synthétique.

Le plus dérangeant, ce n'est pas que ce modèle existe. C'est que, dans plusieurs dimensions mesurables, il peut être plus précis à votre sujet que vous ne l'êtes.

Qu'est-ce qu'une Identité Synthétique (et Pourquoi ce n'est Pas ce que Vous Pensez)

La plupart des gens entendent "identité synthétique" et pensent fraude – numéros de sécurité sociale volés, faux profils, arnaques aux cartes de crédit. C'est l'une des utilisations du terme. Mais dans le domaine plus large de la psychologie computationnelle et de l'IA comportementale, une identité synthétique fait référence au modèle numérique composite construit à partir de vos données comportementales, transactionnelles et sociales.

Pensez-y comme un clone comportemental, assemblé à partir de :

- Données de parcours de navigation (clickstream data) — où votre curseur se déplace, combien de temps vous hésitez avant de cliquer

- Modèles temporels — quand vous magasinez, quand vous lisez, quand vous prenez des décisions impulsives (indice : généralement après 22h)

- Empreintes linguistiques — choix des mots, longueur des phrases, ton émotionnel à travers les messages et les publications

- Séquences d'achat et de consommation — ce que vous achetez après une semaine stressante par rapport à une semaine calme

- Signaux du graphe social — qui influence vos décisions sans que vous ne vous en rendiez compte

Des plateformes comme Netflix, Spotify et Amazon n'utilisent pas cela uniquement pour recommander du contenu. Elles l'utilisent pour modéliser vos états futurs. Votre identité synthétique n'est pas seulement un enregistrement de qui vous étiez. C'est une projection probabiliste de qui vous êtes sur le point d'être.

L'écart psychologique : pourquoi vous êtes un moins bon juge de vous-même qu'un algorithme

Les humains portent une charge cognitive impressionnante de biais. Vous vous engagez dans l'attribution égoïste (vos succès sont dus à vos compétences ; vos échecs à des circonstances). Vous êtes victime du biais du présent, surévaluant de manière dramatique les récompenses immédiates par rapport aux futures. Vous reconstruisez les souvenirs plutôt que de les rejouer.

Votre identité synthétique, en revanche, ne se ment pas à elle-même.

Une étude de 2020 du Computational Social Science Lab de Stanford a révélé que les modèles d'IA entraînés sur les "J'aime" de Facebook prédisaient les traits de personnalité avec plus de précision que les auto-évaluations des utilisateurs — et, dans certaines dimensions, plus précisément que leurs conjoints. Le modèle avait traité 300 "J'aime". Votre conjoint a traité des années d'expérience vécue. L'algorithme a gagné.

Ce n'est pas un tour de passe-passe. Cela reflète une asymétrie fondamentale :

Vous vivez votre vie de l'intérieur, filtrée par l'ego, l'émotion et la narration. Le modèle vous expérimente de l'extérieur, filtré par rien d'autre que la régularité statistique.

Cette asymétrie a des conséquences pratiques partout — des publicités qui vous convertissent aux primes d'assurance que vous payez en passant par les candidatures d'emploi qui sont automatiquement rejetées.

Comment la confiance s'inverse

Voici le coup de poing philosophique : si votre identité synthétique prédit votre comportement plus précisément que vous ne prédisez le vôtre, alors les systèmes construits sur ce modèle peuvent prendre de meilleures décisions à votre sujet que vous n'en prenez vous-même — du moins dans des domaines étroits et bien définis.

La notation de crédit est l'exemple le plus ancien. Votre score FICO est essentiellement un fragment d'identité synthétique. Et étude après étude montre que les décisions de crédit algorithmiques, bien que systématiquement biaisées dans certaines populations, sont moins biaisées que les agents de crédit humains qui prennent des décisions subjectives. L'algorithme ne se soucie pas que vous rappeliez à l'agent de crédit son frère peu fiable.

La véritable inversion de la confiance se produit lorsque vous commencez à vous demander : qui mon identité synthétique sert-elle ?

- Elle vous sert lorsque le modèle de Netflix vous évite de perdre une heure sur un film que vous détesteriez.

- Elle sert une entreprise lorsque ce même modèle identifie votre fenêtre de vulnérabilité émotionnelle et vous diffuse une publicité ciblée pendant celle-ci.

- Elle sert un État lorsque des systèmes de notation comportementale (pensez au système de crédit social chinois, ou aux algorithmes de police prédictive utilisés aux États-Unis) utilisent votre identité synthétique pour restreindre vos options avant que vous n'ayez agi.

Le modèle est neutre. Le déploiement ne l'est pas.