La démocratisation de la biologie de synthèse, autrefois saluée comme l'aube d'une "Troisième Révolution Industrielle", a heurté un mur opérationnel sinistre en 2026. Alors que l'infrastructure de la recherche biologique distribuée passe de installations centralisées et hautement sécurisées à un réseau tentaculaire et décentralisé de laboratoires intégrés au cloud, les hypothèses de biosécurité de l'ère 2020 se sont largement effondrées. Le Rapport de Vulnérabilité 2026 – un ensemble de données agrégées compilé par des consortiums de surveillance indépendants et des journaux d'audit internes divulgués – dépeint un secteur qui peine à gérer les risques existentiels posés par sa propre évolutivité.

Le problème n'est plus celui d'un "scientifique fou" dans un sous-sol ; il s'agit d'une défaillance systémique, à l'instar de ce que l'on observe dans les chaînes d'approvisionnement traditionnelles du commerce électronique qui échouent en 2026, où les plateformes de synthèse automatisées, pilotées par API, sous-tendent désormais la fabrication mondiale de biotechnologies.

L'érosion du filtrage physique

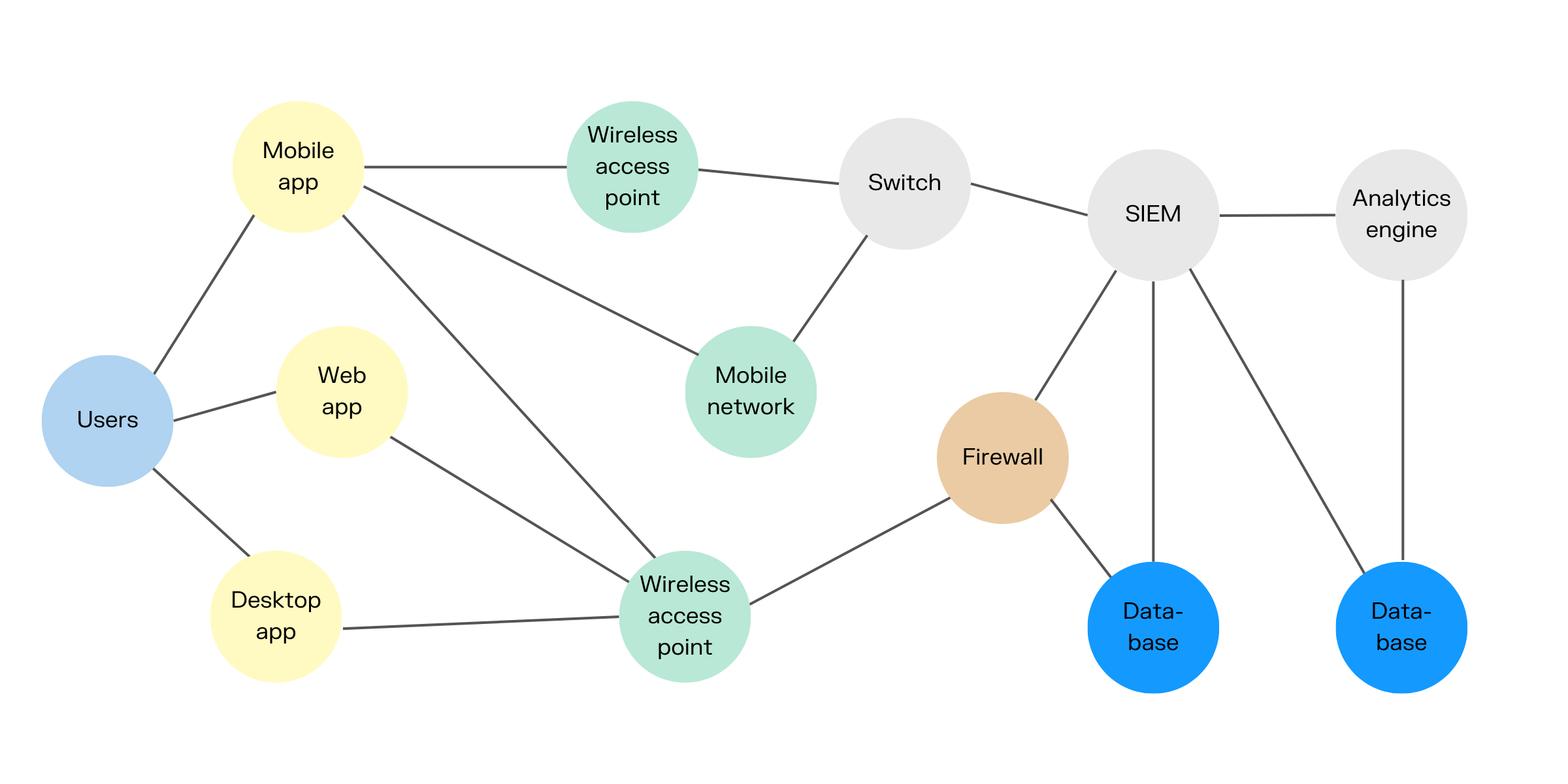

Pendant des décennies, la biosécurité était physique. Elle reposait sur des lecteurs de badges, une filtration d'air robuste et un groupe restreint de personnel autorisé. Aujourd'hui, cette barrière physique a été rendue presque insignifiante par le modèle "Laboratoire-dans-le-Cloud". Les chercheurs soumettent désormais des séquences d'ADN via des appels API cryptés à des organismes de recherche sous contrat (CRO) qui possèdent du matériel de synthèse propriétaire.

Le goulot d'étranglement de la sécurité s'est déplacé de la porte du laboratoire vers le middleware natif du cloud qui connecte le logiciel de conception du chercheur au firmware du synthétiseur. En 2026, la vulnérabilité n'est plus seulement une violation physique ; c'est une "injection en amont", une fragilité qui rappelle que le trading d'IA déstabilise les marchés mondiaux en exploitant des failles similaires. Si un attaquant compromet un compte, il peut agir avec une facilité déconcertante, tout comme la plupart des entonnoirs d'affiliation automatisés échouent à grande échelle à cause d'une logique algorithmique mal maîtrisée.

"Nous l'avons vu dans les problèmes GitHub de l'OpenBio-API au début de 2026", déclare Marcus Thorne, un pseudonyme pour un chercheur en cybersécurité qui surveille les fils de discussion sur la biosécurité sur les forums du darknet. "Les développeurs priorisaient la faible latence pour les commandes de synthèse automatisées. Ils ont mis en place un processus de criblage à plusieurs niveaux où les partenaires institutionnels 'vérifiés' obtenaient des délais d'exécution plus rapides. Le contournement n'était pas un hack complexe ; c'était un exploit de la liste blanche d'examen accéléré. Si vous reproduisez la structure de métadonnées d'une université de premier rang, l'algorithme de criblage ignore effectivement l'analyse approfondie de la séquence."

L'écosystème du "Laboratoire de l'Ombre"

La réalité la plus dangereuse de 2026 est la croissance de l'écosystème du "Laboratoire de l'Ombre". Tout comme les marchés du dark web de la décennie précédente, ces plateformes facilitent la synthèse de séquences qui déclenchent des alertes automatisées sur les plateformes commerciales légitimes.

L'industrie parle de "dérive protocolaire". Lorsque les synthétiseurs commerciaux renforcent leur logique de criblage, les chercheurs — ou ceux ayant des intentions malveillantes — se tournent vers du matériel décentralisé et open-source qui n'impose pas le criblage des séquences par conception. Ce n'est pas un échec politique ; c'est un choix de conception fondamental. La communauté du matériel bio-open-source, qui prospère largement sur des plateformes comme GitLab, soutient qu'un criblage strict empêche l'innovation, une philosophie d'ouverture qui contraste avec la nécessité de laisser les grands PDG délaisser les outils numériques pour une clarté analogique afin de mieux sécuriser les systèmes critiques.

"Si nous intégrons un 'interrupteur d'arrêt' ou une couche de criblage obligatoire, nous remettons en fait les clés de notre infrastructure de recherche à l'entité corporative qui possède le middleware cloud", a écrit un mainteneur d'un séquenceur open-source populaire dans un fil de discussion public. "Nous ne créons pas de risques de biosécurité ; nous créons un bac à sable pour la science indépendante."

Échecs de mise à l'échelle et frictions opérationnelles

La réalité opérationnelle est bien plus compliquée que ce que suggèrent les brochures brillantes des startups de biotechnologie. En 2026, la mise à l'échelle des laboratoires distribués a créé un "cauchemar de support". Un fil de discussion courant sur /r/biohackers de Reddit ou sur les canaux de support technique pour l'automatisation de laboratoire industrielle montre un schéma récurrent : des délais d'attente matériels causés par des bogues de firmware qui surviennent pendant les dernières étapes d'une exécution de synthèse.

Lorsque ces systèmes tombent en panne — ce qu'ils font avec une fréquence surprenante — ils échouent souvent dans un état irrécupérable et "sale". Dans un incident fin 2025, un laboratoire en Europe a tenté d'automatiser la production d'un échafaudage protéique sur mesure. Un kernel panic dans l'unité de contrôle locale s'est produit exactement au moment où le système devait initier le cycle de nettoyage du synthétiseur d'ADN. Le résultat a été une unité contaminée restée hors ligne pendant trois semaines, tandis que l'équipe informatique locale peinait à trouver un technicien de support à distance capable d'accéder au firmware propriétaire.

Ce problème de "tuyau cassé" est endémique. Parce que la main-d'œuvre gérant ces laboratoires est de plus en plus décentralisée et moins spécialisée, lorsqu'un appareil rencontre une erreur de "cas limite", il reste là, inutile et potentiellement biologiquement actif.

L'illusion de la sécurité algorithmique

L'industrie a dépensé des milliards en "IA de criblage" – des algorithmes qui recoupent les séquences d'ADN soumises avec des bases de données de pathogènes connus. Mais le Rapport 2026 indique que ces bases de données sont en retard par rapport aux découvertes du monde réel.

"Le problème fondamental est que la base de données de séquences 'dangereuses' est statique, tandis que la science de la biologie de synthèse est hyper-dynamique", note le Dr Elena Vance, ancienne consultante pour une importante société de bioinformatique. "Vous ne pouvez pas simplement mettre une chaîne de code génétique sur liste noire. La fonctionnalité dépend du contexte. Une séquence peut être inoffensive dans un cadre de référence et hautement toxique dans un autre. Les algorithmes recherchent des signatures, pas des fonctions."

C'est là qu'intervient la "Culture du Contournement". Confrontés à des rejets automatisés pour des recherches légitimes, potentiellement sensibles, les chercheurs ont commencé à adopter des techniques d'obscurcissement. Ils fragmentent les séquences en segments plus petits, introduisent des données "parasites" sans signification pour brouiller les algorithmes de correspondance, et réassemblent les séquences dans leurs propres environnements de laboratoire locaux et non réglementés. Ce processus de réassemblage manuel augmente considérablement le risque de contamination et d'accidents de laboratoire.

Étude de cas : La "Sync-Breach" de juillet 2026

En juillet 2026, une série de commandes de synthèse non autorisées passées via un compte de recherche compromis a déclenché une panique généralisée dans l'industrie. L'attaquant avait réussi à injecter une séquence génétique obscurcie, potentiellement dangereuse, dans une commande légitime et à grande échelle d'ADN synthétique. Parce que la commande était liée à un compte jouissant d'une longue réputation de recherche standard et à grand volume, les systèmes d'alerte automatisés l'ont traitée comme un événement de "haute confiance".