La democratización de la biología sintética, una vez anunciada como el amanecer de una "Tercera Revolución Industrial", ha chocado contra un sombrío muro operativo en 2026. A medida que la infraestructura para la investigación biológica distribuida se traslada de instalaciones centralizadas de alta seguridad a una vasta red descentralizada de laboratorios integrados en la nube, las suposiciones de bioseguridad de la era de 2020 se han desmoronado en gran medida. El Informe de Vulnerabilidad de 2026, un conjunto de datos agregado compilado por consorcios de vigilancia independientes y registros de auditorías internas filtrados, pinta un panorama de un sector que lucha por gestionar los riesgos existenciales que plantea su propia escalabilidad.

El problema ya no es el de un "científico loco" en un sótano; se trata del fallo sistémico de las plataformas automatizadas, un problema de escalabilidad que también explica por qué la mayoría de los embudos de afiliados automatizados fallan a escala.

La erosión del control de acceso físico

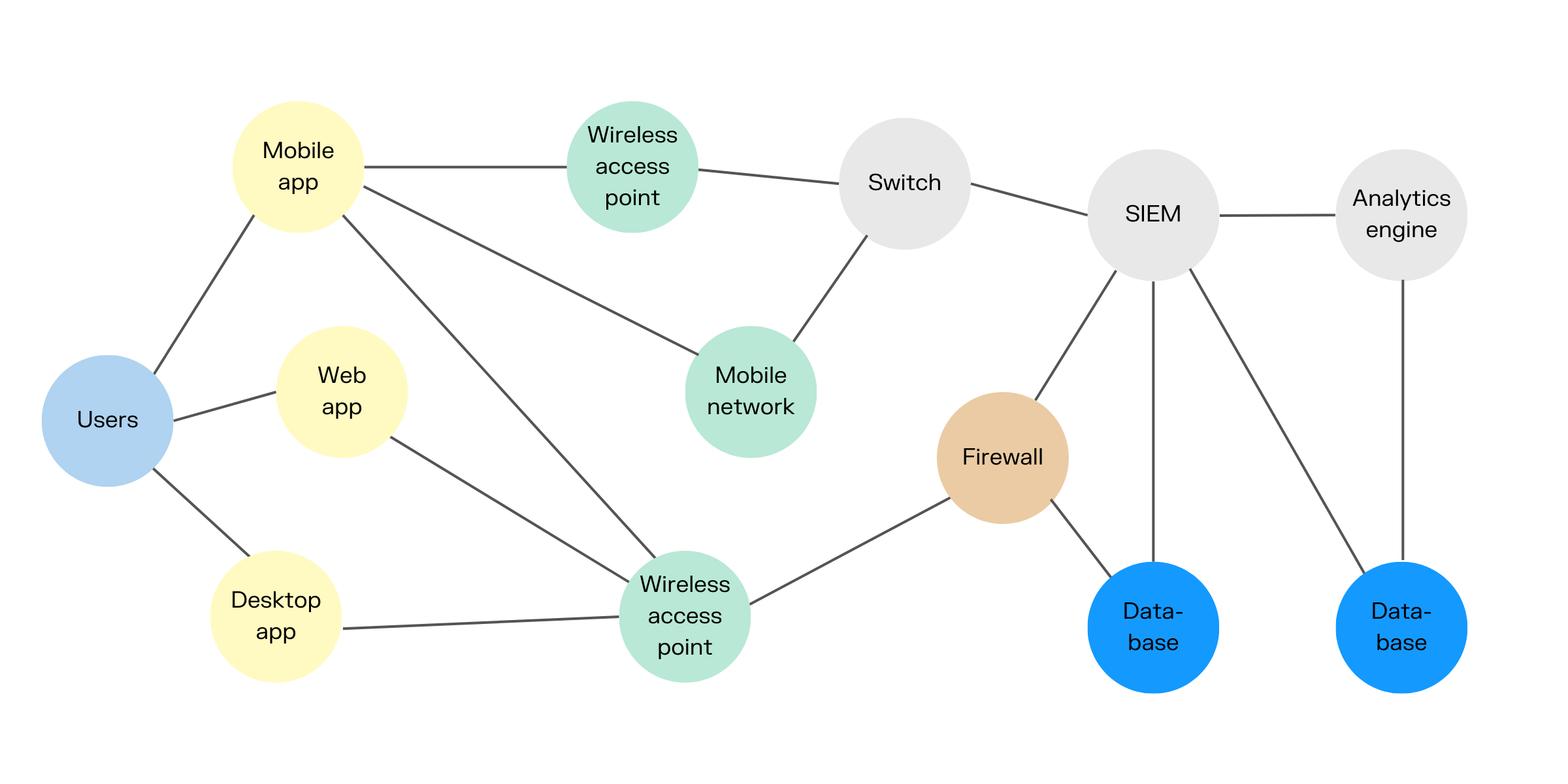

Durante décadas, la bioseguridad fue física. Se basaba en lectores de tarjetas, filtración de aire de alta resistencia y un grupo selecto de personal autorizado. Hoy en día, esa barrera física se ha vuelto casi irrelevante por el modelo de "Laboratorio en la Nube". Los investigadores ahora envían secuencias de ADN a través de llamadas API cifradas a organizaciones de investigación por contrato (CROs) que poseen hardware de síntesis propietario.

El cuello de botella de la seguridad se ha desplazado de la puerta del laboratorio al middleware nativo de la nube que conecta el software de diseño del investigador con el firmware del sintetizador. En 2026, la vulnerabilidad no es solo una brecha física; es una "inyección upstream". Si un atacante compromete el token de autenticación de una cuenta de investigación legítima en una plataforma importante de biología sintética, como el ampliamente utilizado middleware "HelixSync", puede eludir los protocolos de cribado de secuencias automatizados que se supone que detectan patógenos conocidos.

"Lo vimos en los problemas de GitHub para la OpenBio-API a principios de 2026", dice Marcus Thorne, un seudónimo de un investigador de ciberseguridad que monitorea los hilos de bioseguridad en foros de la darknet. "Los desarrolladores estaban priorizando la baja latencia para los pedidos de síntesis automatizada. Implementaron un proceso de cribado por niveles donde los socios institucionales 'verificados' obtenían plazos de entrega más rápidos. El bypass no fue un hack complejo; fue una explotación de la lista blanca de 'revisión acelerada'. Si replicas la estructura de metadatos de una universidad de primer nivel, el algoritmo de cribado salta efectivamente el análisis de secuencia profunda."

El ecosistema del "Laboratorio en la Sombra"

La realidad más peligrosa de 2026 es el crecimiento del ecosistema de "Laboratorio en la Sombra", una fragmentación del mercado que guarda paralelismos con los desafíos de otros sectores, como el análisis de por qué la IA de trading está desestabilizando los mercados globales en 2026. Al igual que los mercados de la dark web de la década anterior, estas plataformas facilitan la síntesis de secuencias que activan alertas rojas automáticas en plataformas comerciales legítimas.

La industria se refiere a esto como "deriva de protocolo". Cuando los sintetizadores comerciales endurecen su lógica de cribado, los investigadores —o aquellos con intenciones maliciosas— se trasladan a hardware descentralizado de código abierto que no impone el cribado de secuencias por diseño. Esto no es un fallo de política; es una elección de diseño fundamental. La comunidad de hardware bio de código abierto, que prospera en gran medida en plataformas como GitLab y servidores de Discord especializados, argumenta que el cribado estricto y codificado impide la innovación legítima.

"Si construimos un 'interruptor de seguridad' o una capa de cribado obligatoria, esencialmente entregamos las llaves de nuestra infraestructura de investigación a cualquier entidad corporativa que sea propietaria del middleware de la nube", escribió un mantenedor de un popular secuenciador de código abierto en un hilo público. "No estamos creando riesgos de bioseguridad; estamos creando un sandbox para la ciencia independiente."

Fallos de escalabilidad y fricción operativa

La realidad operativa es mucho más complicada de lo que sugieren los folletos brillantes de las startups biotecnológicas. En 2026, la escalabilidad de los laboratorios distribuidos ha creado una "Pesadilla de Soporte". Un hilo común en /r/biohackers de Reddit o en los canales de soporte técnico para la automatización de laboratorios industriales muestra un patrón recurrente: tiempos de espera de hardware causados por bugs de firmware que ocurren durante las etapas finales de una ejecución de síntesis.

Cuando estos sistemas fallan —lo que hacen con sorprendente frecuencia— a menudo fallan en un estado "sucio" e irrecuperable. En un incidente a finales de 2025, un laboratorio en Europa intentó automatizar la producción de un andamio proteico a medida. Un kernel panic en la unidad de control local ocurrió exactamente cuando el sistema debía iniciar el ciclo de limpieza del sintetizador de ADN. El resultado fue una unidad contaminada que permaneció fuera de línea durante tres semanas, mientras el equipo de TI local luchaba por encontrar un técnico de soporte remoto que pudiera acceder al firmware propietario.

Este problema de "tubería rota" es endémico. Debido a que la fuerza laboral que gestiona estos laboratorios está cada vez más descentralizada y menos especializada, cuando un dispositivo encuentra un error de "caso límite", permanece allí, inútil y potencialmente biológicamente activo.

La ilusión de la seguridad algorítmica

La industria ha gastado miles de millones en "IA de cribado" —algoritmos que cotejan las secuencias de ADN enviadas con bases de datos de patógenos conocidos. Pero el Informe de 2026 indica que estas bases de datos están rezagadas con respecto a los descubrimientos del mundo real.

"El problema fundamental es que la base de datos de secuencias 'peligrosas' es estática, mientras que la ciencia de la biología sintética es hiperdinámica", señala la Dra. Elena Vance, exconsultora de una importante empresa de bioinformática. "No se puede simplemente poner en una lista negra una cadena de código genético. La funcionalidad depende del contexto. Una secuencia podría ser inofensiva en un marco de referencia y altamente tóxica en otro. Los algoritmos buscan firmas, no funciones."

Aquí es donde entra en juego la "Cultura de la Solución Alternativa". Los investigadores, ante rechazos automáticos por investigaciones legítimas y potencialmente sensibles, han comenzado a adoptar técnicas de ofuscación. Cortan secuencias en segmentos más pequeños, introducen datos "sin sentido" para desordenar los algoritmos de coincidencia y reensamblan las secuencias en sus propios entornos de laboratorio locales y no regulados. Este proceso de reensamblaje manual aumenta significativamente el riesgo de contaminación y accidentes de laboratorio.

Caso de estudio: La "Sync-Breach" de julio de 2026

En julio de 2026, una serie de órdenes de síntesis no autorizadas realizadas a través de una cuenta de investigación comprometida provocó un pánico en toda la industria. El atacante había logrado inyectar una secuencia genética ofuscada y potencialmente dañina en una orden legítima y a gran escala de ADN sintético. Debido a que la orden estaba vinculada a una cuenta con una reputación de larga data en investigación estándar de gran volumen, los sistemas de alerta automáticos la trataron como un evento de "alta confianza".