Kurzantwort: Ihr digitaler Avatar – der Verhaltens-Fingerabdruck, der aus Ihren Klicks, Pausen, Käufen und Mustern erstellt wird – sagt Ihre Entscheidungen oft voraus, bevor Sie sie bewusst treffen. Systeme für synthetische Identitäten aggregieren diese Daten zu einem Modell, das konsistenter, weniger voreingenommen und unheimlich mehr „Sie“ sein kann als Ihre eigene Selbstwahrnehmung. Die Auswirkungen auf Vertrauen, Privatsphäre und Handlungsfähigkeit sind tiefgreifend.

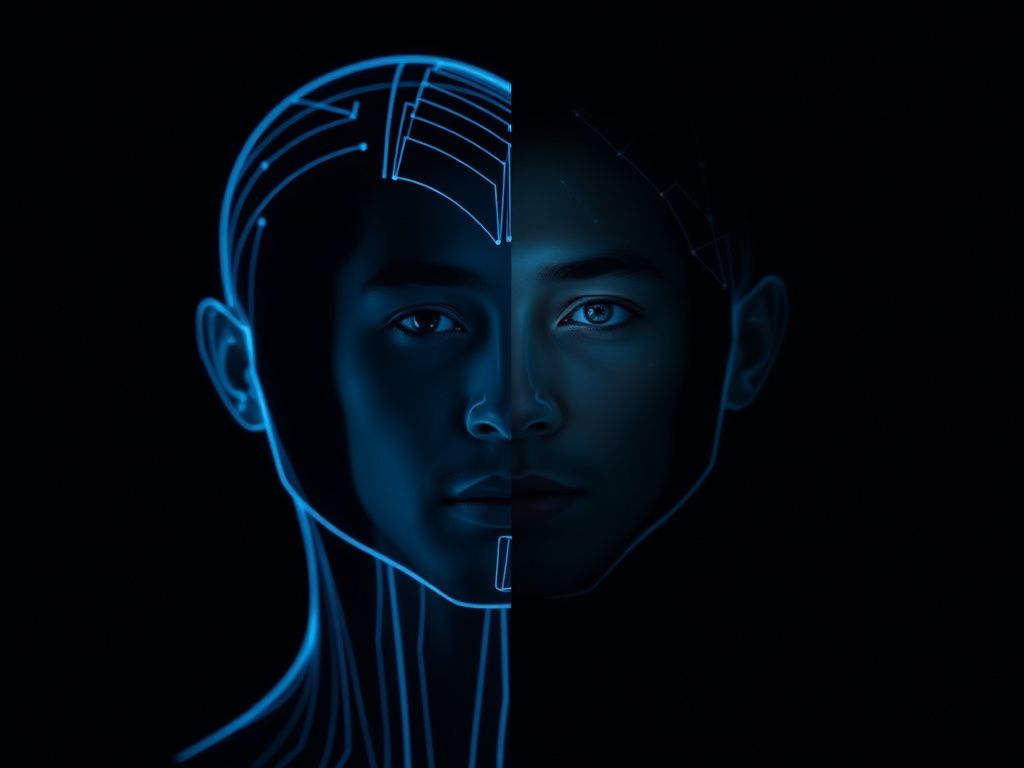

Gerade läuft ein stilles Experiment mit Ihnen. Jede App, die Sie öffnen, jede Suchanfrage, die Sie auf halbem Weg abbrechen, jedes Produkt, über das Sie drei Sekunden lang schweben, bevor Sie den Tab schließen – all das speist eine Maschine, die eine Version von Ihnen zusammensetzt. Keine Karikatur. Ein hochpräzises Verhaltensmodell. Eine synthetische Identität.

Das Beunruhigende ist nicht, dass dieses Modell existiert. Es ist, dass es in mehreren messbaren Dimensionen genauer über Sie Auskunft geben kann als Sie selbst.

Was ist eine synthetische Identität (und warum ist es nicht, was Sie denken)

Die meisten Leute hören „synthetische Identität“ und denken an Betrug – gestohlene Sozialversicherungsnummern, erfundene Personas, Kreditkartenbetrug. Das ist eine Verwendung des Begriffs. Aber im weiteren Bereich der Computerpsychologie und Verhaltens-KI bezieht sich eine synthetische Identität auf das zusammengesetzte digitale Modell, das aus Ihren Verhaltens-, Transaktions- und sozialen Daten konstruiert wird.

Stellen Sie es sich als einen Verhaltensklon vor, der zusammengesetzt ist aus:

- Klickpfad-Daten — wohin sich Ihr Cursor bewegt, wie lange Sie zögern, bevor Sie klicken

- Zeitliche Muster — wann Sie einkaufen, wann Sie lesen, wann Sie impulsive Entscheidungen treffen (Hinweis: meistens nach 22 Uhr)

- Linguistische Fingerabdrücke — Wortwahl, Satzlänge, emotionaler Tonfall über Nachrichten und Beiträge hinweg

- Kauf- und Konsumsequenzen — was Sie nach einer stressigen Woche im Vergleich zu einer ruhigen Woche kaufen

- Soziale Graphensignale — wer Ihre Entscheidungen beeinflusst, ohne dass Sie es merken

Plattformen wie Netflix, Spotify und Amazon nutzen dies nicht nur, um Inhalte zu empfehlen. Sie nutzen es, um Ihre zukünftigen Zustände zu modellieren. Ihre synthetische Identität ist nicht nur eine Aufzeichnung dessen, wer Sie waren. Es ist eine probabilistische Projektion dessen, wer Sie sein werden.

Die Psychologie-Lücke: Warum Sie ein schlechterer Richter über sich selbst sind als ein Algorithmus

Menschen tragen eine erstaunliche kognitive Last von Verzerrungen mit sich herum. Sie betreiben eigennützige Attribution (Ihre Erfolge sind Können; Ihre Misserfolge sind Umstände). Sie fallen dem Gegenwarts-Bias zum Opfer und überbewerten unmittelbare Belohnungen gegenüber zukünftigen dramatisch. Sie rekonstruieren Erinnerungen, anstatt sie abzuspielen.

Ihre synthetische Identität hingegen lügt sich selbst nicht an.

Eine Studie aus dem Jahr 2020 vom Computational Social Science Lab in Stanford ergab, dass KI-Modelle, die auf Facebook-Likes trainiert wurden, Persönlichkeitsmerkmale genauer vorhersagten als die Selbsteinschätzungen der Nutzer – und in einigen Dimensionen genauer als ihre Ehepartner. Das Modell hatte 300 Likes verarbeitet. Ihr Ehepartner hat jahrelange Lebenserfahrung verarbeitet. Der Algorithmus gewann.

Das ist kein Trick. Es spiegelt eine grundlegende Asymmetrie wider:

Sie erleben Ihr Leben von innen heraus, gefiltert durch Ego, Emotion und Erzählung. Das Modell erlebt Sie von außen, gefiltert durch nichts außer statistische Regelmäßigkeit.

Diese Asymmetrie hat überall praktische Konsequenzen – von den Anzeigen, die Sie konvertieren, über die Versicherungsprämien, die Sie zahlen, bis hin zu den Bewerbungen, die automatisch aussortiert werden.

Wie Vertrauen invertiert wird

Hier ist der philosophische Tiefschlag: Wenn Ihre synthetische Identität Ihr Verhalten genauer vorhersagt, als Sie Ihr eigenes Verhalten vorhersagen, dann können Systeme, die auf diesem Modell basieren, bessere Entscheidungen über Sie treffen, als Sie über sich selbst treffen – zumindest in engen, genau definierten Bereichen.

Die Kreditwürdigkeitsprüfung ist das älteste Beispiel. Ihr FICO-Score ist im Wesentlichen ein Fragment einer synthetischen Identität. Und Studie um Studie zeigt, dass algorithmische Kreditentscheidungen, obwohl sie in einigen Bevölkerungsgruppen systemisch voreingenommen sind, weniger voreingenommen sind als menschliche Kreditberater, die subjektive Entscheidungen treffen. Dem Algorithmus ist es egal, dass Sie den Kreditberater an seinen unzuverlässigen Bruder erinnern.

Die eigentliche Vertrauensinversion findet statt, wenn Sie sich fragen: Wem dient meine synthetische Identität?

- Sie dient Ihnen, wenn das Netflix-Modell Sie davor bewahrt, eine Stunde mit einem Film zu verschwenden, den Sie hassen würden.

- Sie dient einem Unternehmen, wenn dasselbe Modell Ihr emotionales Verwundbarkeitsfenster identifiziert und währenddessen eine gezielte Anzeige schaltet.

- Sie dient einem Staat, wenn Verhaltensbewertungssysteme (denken Sie an Chinas Sozialkreditsystem oder die in den USA verwendeten prädiktiven Polizeialgorithmen) Ihre synthetische Identität nutzen, um Ihre Optionen einzuschränken, bevor Sie gehandelt haben.

Das Modell ist neutral. Die Anwendung ist es nicht.