Die Demokratisierung der synthetischen Biologie, einst als Beginn einer „Dritten Industriellen Revolution“ gefeiert, ist im Jahr 2026 an eine ernüchternde, operative Wand gestoßen. Während die Infrastruktur für die dezentrale biologische Forschung von zentralisierten, hochsicheren Einrichtungen zu einem weit verzweigten, dezentralen Netzwerk von Cloud-integrierten Laboren übergeht, sind die Annahmen der Biosicherheit aus der Zeit um 2020 weitgehend zusammengebrochen. Der Vulnerability Report 2026 – ein aggregierter Datensatz, der von unabhängigen Watchdog-Konsortien und geleakten internen Prüfprotokollen zusammengestellt wurde – zeichnet ein Bild eines Sektors, der mit der Bewältigung der existenziellen Risiken seiner eigenen Skalierbarkeit kämpft.

Das Problem ist nicht mehr der „verrückte Wissenschaftler“ im Keller; es ist das banale, systemische Versagen API-gesteuerter, automatisierter Syntheseplattformen, ähnlich wie man es auch bei anderen Systemen sieht, bei denen Warum die meisten automatisierten Affiliate-Funnels im großen Maßstab scheitern beobachten kann.

Die Erosion physischer Zugangskontrollen

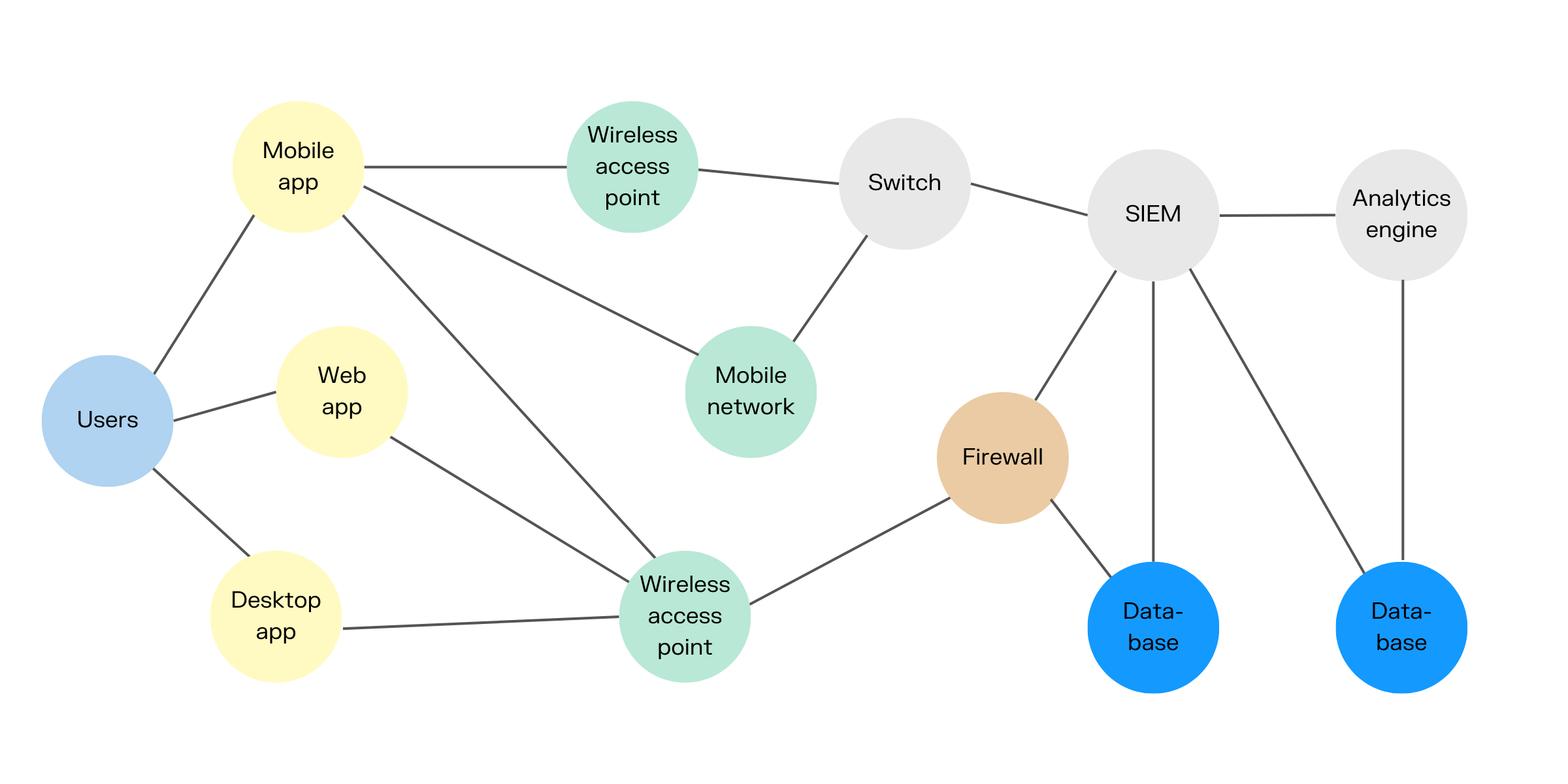

Jahrzehntelang war Biosicherheit physisch. Sie basierte auf Ausweislesern, Hochleistungs-Luftfiltration und einer ausgewählten Gruppe autorisierten Personals. Heute ist diese physische Barriere durch das „Lab-in-the-Cloud“-Modell nahezu irrelevant geworden. Forscher übermitteln DNA-Sequenzen über verschlüsselte API-Aufrufe an Auftragsforschungsorganisationen (CROs), die über proprietäre Synthesehardware verfügen.

Der Sicherheitsengpass hat sich von der Labortür auf die Cloud-native Middleware verlagert; dies unterstreicht, warum Experten heute warnen, dass Warum traditionelle Cyber-Versicherungspolicen gegen KI-Ransomware versagen, da sich die Angriffsflächen rasant verändern. Im Jahr 2026 ist die Schwachstelle nicht nur eine physische Verletzung; es ist eine „Upstream Injection“. Wenn ein Angreifer das Authentifizierungstoken eines legitimen Forschungskontos auf einer großen Plattform für synthetische Biologie – wie der weit verbreiteten „HelixSync“-Middleware – kompromittiert, kann er die automatisierten Sequenz-Screening-Protokolle umgehen, die eigentlich bekannte Krankheitserreger abfangen sollen.

„Wir haben es in den GitHub-Issues für die OpenBio-API schon Anfang 2026 gesehen“, sagt Marcus Thorne, ein Pseudonym für einen Cybersicherheitsforscher, der Biosicherheits-Threads in Darknet-Foren überwacht. „Die Entwickler priorisierten niedrige Latenzzeiten für automatisierte Syntheseaufträge. Sie implementierten einen gestuften Screening-Prozess, bei dem ‚verifizierte‘ institutionelle Partner schnellere Bearbeitungszeiten erhielten. Die Umgehung war kein komplexer Hack; es war ein Exploit der ‚beschleunigten Überprüfung‘-Whitelist. Wenn man die Metadatenstruktur einer Top-Universität spiegelt, überspringt der Screening-Algorithmus effektiv die Tiefenanalyse der Sequenz.“

Das „Schattenlabor“-Ökosystem

Die gefährlichste Realität des Jahres 2026 ist das Wachstum des „Schattenlabor“-Ökosystems. Ähnlich den Dark-Web-Marktplätzen des letzten Jahrzehnts ermöglichen diese Plattformen die Synthese von Sequenzen, die auf legitimen kommerziellen Plattformen automatische rote Flaggen auslösen würden.

Die Industrie spricht hier von „Protokolldrift“. Wenn kommerzielle Synthesizer ihre Screening-Logik verschärfen, wechseln Forscher – oder solche mit böswilliger Absicht – zu dezentraler, quelloffener Hardware, die von Haus aus kein Sequenz-Screening erzwingt. Dies ist kein politisches Versagen; es ist eine grundlegende Designentscheidung. Die Open-Source-Bio-Hardware-Community, die größtenteils auf Plattformen wie GitLab und Nischen-Discord-Servern floriert, argumentiert, dass strenge Screenings Innovationen verhindern – ein digitaler Diskurs, der in seiner Komplexität fast an den Wandel erinnert, in dem Warum Top-CEOs digitale Tools für analoge Klarheit aufgeben diskutiert wird.

„Wenn wir einen ‚Kill-Switch‘ oder eine obligatorische Screening-Schicht einbauen, übergeben wir die Schlüssel zu unserer Forschungsinfrastruktur effektiv dem Unternehmen, das zufällig die Cloud-Middleware besitzt“, schrieb ein Maintainer, der damit ein Dilemma beschreibt, das uns auch in anderen Bereichen wie bei der Frage beschäftigt, wie Der Aufstieg des autonomen Affiliate-Marketings: Wie KI menschliche Teams ersetzt die Kontrolle verschiebt. „Wir schaffen keine Biosicherheitsrisiken; wir schaffen eine Sandbox für unabhängige Wissenschaft.“

Skalierungsfehler und operativer Reibungswiderstand

Die operative Realität ist wesentlich chaotischer, als die glänzenden Broschüren der Biotech-Startups vermuten lassen. Im Jahr 2026 hat die Skalierung dezentraler Labore ein „Support-Albtraum“ geschaffen. Ein häufiger Thread auf Reddit’s /r/biohackers oder technischen Support-Kanälen für industrielle Laborautomatisierung zeigt ein wiederkehrendes Muster: Hardware-Timeouts, verursacht durch Firmware-Fehler, die in den letzten Phasen eines Syntheselaufs auftreten.

Wenn diese Systeme ausfallen – was mit überraschender Häufigkeit geschieht – fallen sie oft in einem nicht wiederherstellbaren, „schmutzigen“ Zustand aus. Bei einem Vorfall Ende 2025 versuchte ein Labor in Europa, die Produktion eines maßgeschneiderten Proteingerüsts zu automatisieren. Ein Kernel-Panic in der lokalen Steuereinheit trat genau dann auf, als das System den Reinigungszyklus für den DNA-Synthesizer einleiten sollte. Das Ergebnis war eine kontaminierte Einheit, die drei Wochen lang offline blieb, während das lokale IT-Team darum kämpfte, einen Remote-Support-Techniker zu finden, der auf die proprietäre Firmware zugreifen konnte.

Dieses „defekte Rohr“-Problem ist endemisch. Da die Belegschaft, die diese Labore verwaltet, zunehmend dezentralisiert und weniger spezialisiert ist, bleibt ein Gerät, das einen „Edge-Case“-Fehler aufweist, ungenutzt und potenziell biologisch aktiv.

Die Illusion algorithmischer Sicherheit

Die Industrie hat Milliarden für „Screening AI“ ausgegeben – Algorithmen, die übermittelte DNA-Sequenzen mit Datenbanken bekannter Krankheitserreger abgleichen. Der Bericht 2026 weist jedoch darauf hin, dass diese Datenbanken den realen Entdeckungen hinterherhinken.

„Das grundlegende Problem ist, dass die Datenbank ‚gefährlicher‘ Sequenzen statisch ist, während die Wissenschaft der synthetischen Biologie hyperdynamisch ist“, bemerkt Dr. Elena Vance, eine ehemalige Beraterin einer großen Bioinformatikfirma. „Man kann nicht einfach eine Kette von genetischem Code auf die schwarze Liste setzen. Funktionalität ist kontextabhängig. Eine Sequenz kann in einem Referenzrahmen harmlos und in einem anderen hochtoxisch sein. Die Algorithmen suchen nach Signaturen, nicht nach Funktionen.“

Hier übernimmt die „Workaround-Kultur“. Forscher, die mit automatischen Ablehnungen für legitime, potenziell sensible Forschung konfrontiert sind, haben begonnen, Verschleierungstechniken anzuwenden. Sie zerlegen Sequenzen in kleinere Segmente, fügen „Unsinn“-Junk-Daten ein, um die Matching-Algorithmen zu verwirren, und setzen die Sequenzen in ihren eigenen lokalen, unregulierten Laborumgebungen wieder zusammen. Dieser manuelle Wiederzusammenbau erhöht das Risiko von Kontaminationen und Laborunfällen erheblich.

Fallstudie: Der „Sync-Breach“ im Juli 2026

Im Juli 2026 löste eine Reihe unautorisierter Syntheseaufträge, die über ein kompromittiertes Forschungskonto platziert wurden, eine branchenweite Panik aus. Dem Angreifer war es gelungen, eine verschleierte, potenziell schädliche genetische Sequenz in einen legitimen, großvolumigen Auftrag für synthetische DNA einzuschleusen. Da der Auftrag mit einem Konto verbunden war, das seit langem einen guten Ruf für großvolumige, Standardforschung hatte, behandelten die automatischen Markierungssysteme ihn als ein „Hochvertrauens“-Ereignis.